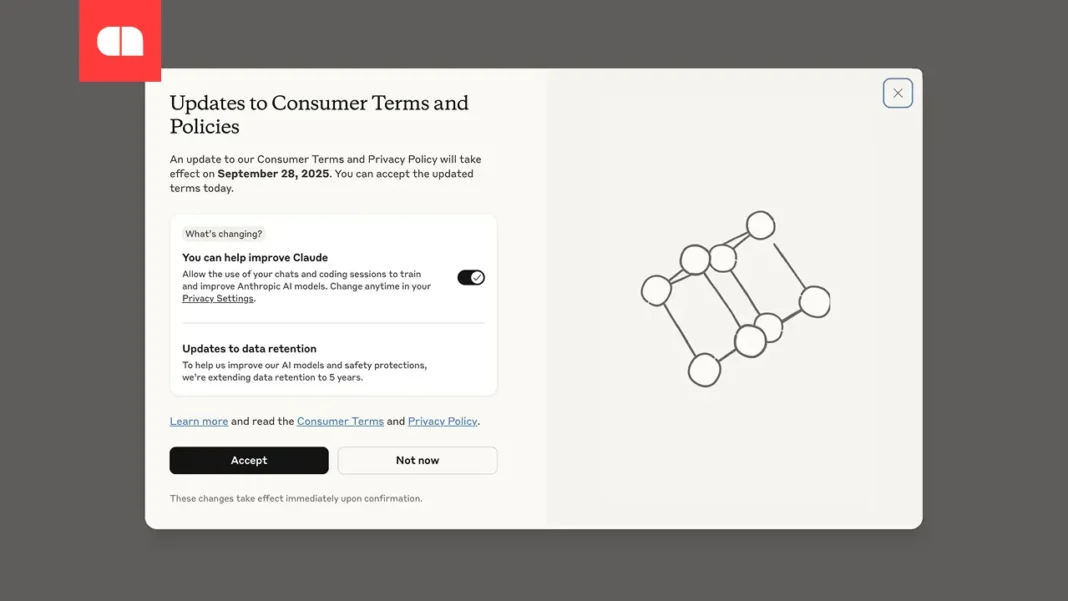

Anthropic изменила условия использования: пользователи будут выбирать использование своих данных

Компания Anthropic объявила об изменениях в условиях использования своих продуктов, которые вступили в силу 28 августа 2025 года. Пользователи смогут самостоятельно решать, разрешать ли использование своих данных для обучения моделей AI Claude и повышения их безопасности.

Изменения в политике компании распространяются на все тарифы моделей Claude, включая Free, Pro, Max и Claude Code, но не касаются продуктов с коммерческими условиями, таких как Claude for Work, Claude Gov, Claude for Education и API, предоставляемые через Amazon Bedrock и Google Cloud Vertex AI. По новым правилам, если пользователь согласится на хранение данных, они будут храниться до пяти лет. Отказ же будет означать сохранение данных в течение 30 дней без возможности использования для обучения моделей.

Пользователи, у которых есть существующие аккаунты, должны принять решение относительно новых настроек до 28 сентября 2025 года. Новички будут определять свои предпочтения во время регистрации, и впоследствии их можно будет изменить в настройках конфиденциальности.

Эти изменения появляются на фоне более широкого тренда повышения внимания к конфиденциальности пользователей в области искусственного интеллекта. Ранее компании OpenAI и Anthropic провели взаимное тестирование своих моделей и опубликовали результаты. Изменения могут повлиять на способ использования данных для развития и улучшения моделей ИИ, в частности, в свете злоупотреблений, которые уже имели место, таких как киберпреступления с использованием Claude.