Anthropic змінила умови користування: користувачі обиратимуть використання своїх даних

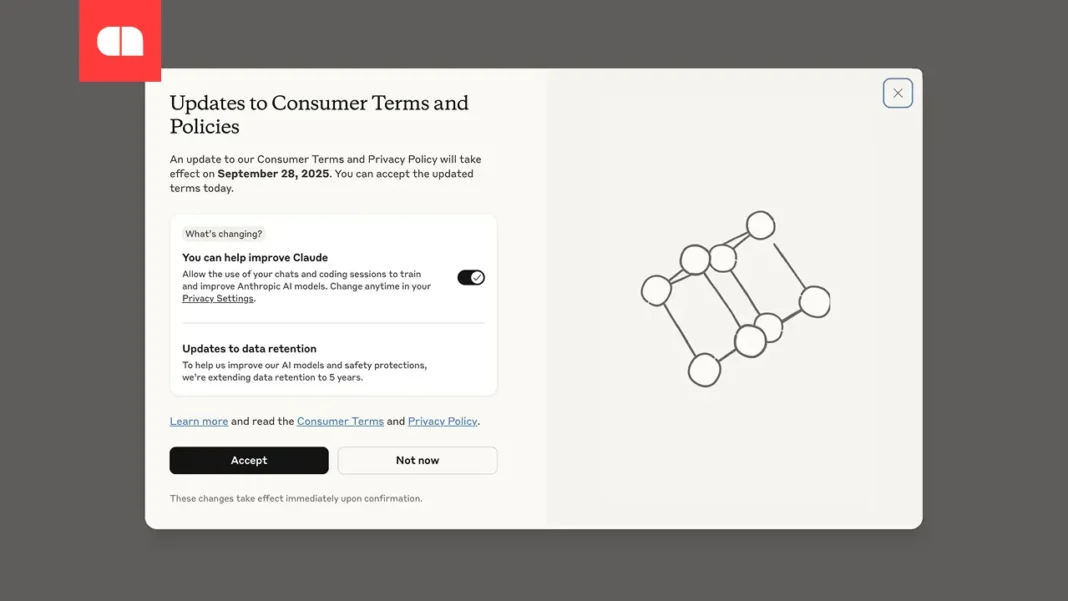

Компанія Anthropic оголосила про зміни в умовах користування своїми продуктами, які набули чинності 28 серпня 2025 року. Користувачі зможуть самостійно вирішити, чи дозволяти використання своїх даних для навчання моделей AI Claude та підвищення їхньої безпеки.

Зміни в політиці компанії поширюються на всі тарифи моделей Claude, включаючи Free, Pro, Max та Claude Code, але не стосуються продуктів з комерційними умовами, як-от Claude for Work, Claude Gov, Claude for Education та API, що надаються через Amazon Bedrock і Google Cloud Vertex AI. За новими правилами, якщо користувач погодиться на зберігання даних, вони зберігатимуться до п’яти років. Відмова ж означатиме збереження даних протягом 30 днів, без можливості використання для тренування моделей.

Користувачі, які мають існуючі акаунти, повинні прийняти рішення щодо нових налаштувань до 28 вересня 2025 року. Новачки визначатимуть свої преференції під час реєстрації, і в подальшому їх можна буде змінити в налаштуваннях конфіденційності.

Ці зміни з’являються на фоні ширшого тренду підвищення уваги до конфіденційності користувачів у галузі штучного інтелекту. Раніше компанії OpenAI і Anthropic провели взаємне тестування своїх моделей і опублікували результати. Зміни можуть вплинути на спосіб використання даних для розвитку та вдосконалення моделей ШІ, зокрема, у світлі зловживань, що вже мали місце, таких як кіберзлочини з використанням Claude.

| Оновлення умов | Термін зберігання даних | Користувачі |

|---|---|---|

| Погодження на використання даних | До 5 років | Усі тарифи Claude |

| Відмова від використання даних | 30 днів | Усі тарифи Claude |

| Комерційні продукти | Не змінено | Claude for Work, Gov, Education, API |